نامه سرگشادۀ کارمندان شرکتهای هوش مصنوعی در حمایت از افشاگران مسائل امنیتی

سوفیانیوز: کارکنان فعلی و سابق شرکتهای مشهور توسعه هوش مصنوعی در نامهای سرگشاده خواستار حمایتهای قویتر از افشاگران مسائل ایمنی هوش مصنوعی شدهاند. این نامه توسط 13 کارمند فعلی و سابق شرکتهای اوپنایآی، گوگل و آنتروپیک امضا شده است.

به گزارش گروه علم و فناوری پایگاه خبری سوفیانیوز به نقل از انگجت، گروهی از کارمندان فعلی و سابق شرکتهای پیشرو در حوزه هوش مصنوعی مانند اوپنایآی(OpenAI)، گوگل دیپمایند(Google DeepMind) و آنتروپیک(Anthropic) نامه سرگشادهای را امضا کردهاند که خواستار شفافیت بیشتر و محافظت در برابر تلافی برای کسانی هستند که درباره نگرانیهای بالقوه هوش مصنوعی صحبت میکنند.

در این نامه که به تازگی منتشر شده آمده است: تا زمانی که نظارت مؤثر دولت بر این شرکتها وجود نداشته باشد، کارمندان فعلی و سابق از معدود افرادی هستند که میتوانند آنها را در برابر مردم پاسخگو کنند. با این حال، توافقنامههای محرمانه گسترده ما را از ابراز نگرانیهایمان باز میدارند.

این نامه تنها چند هفته پس از تحقیقات Vox منتشر میشود که نشان داد شرکت اوپنایآی تلاش کرده است کارکنانی را که اخیراً این شرکت را ترک کردهاند، با وادار کردن آنها به انتخاب بین امضای یک توافقنامه توهین آمیز یا خطر از دست دادن سهام خود در این شرکت سرکوب و ساکت کند.

پس از این گزارش، سم آلتمن مدیر عامل اوپنایآی گفت که او واقعاً از این موضوع شرمنده شده است و ادعا کرد که این توافقنامه از مدارکی که باید هنگام ترک شرکت امضا شوند، حذف شده است. اگرچه مشخص نیست که آیا هنوز برای برخی از کارمندان به قوت خود باقی است یا خیر.

13 امضاکننده این نامه سرگشاده شامل کارمندان سابق اوپنایآی به نامهای جیکوب هینتون، ویلیام ساندرز و دنیل کوکوتایلو هستند.

کوکوتایلو میگوید با از دست دادن اعتماد خود به اینکه هوش عمومی مصنوعی به شکل مسئولانه ایجاد میشود، از این شرکت استعفا داده است. هوش عمومی مصنوعی اصطلاحی برای تعریف سیستمهای هوش مصنوعی است که به اندازه انسان هوشمند یا باهوشتر از انسان هستند.

این نامه که توسط کارشناسان برجسته هوش مصنوعی جفری هینتون، یوشوا بنجیو و استوارت راسل امضا شده است، نگرانی شدیدی را در مورد عدم نظارت مؤثر دولت بر هوش مصنوعی و انگیزههای مالی که غولهای فناوری را به سرمایهگذاری در این فناوری سوق میدهد، ابراز میکند.

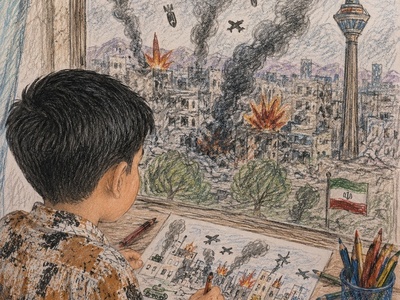

نویسندگان این نامه هشدار میدهند که توسعه بدون نظارت سیستمهای قدرتمند هوش مصنوعی میتواند منجر به انتشار اطلاعات نادرست، تشدید نابرابری و حتی از دست دادن کنترل انسان بر سیستمهای خودمختار شود و حتی به طور بالقوه منجر به انقراض انسان شود.

کوکوتایلو در شبکه اجتماعی ایکس نوشت: خیلی چیزها در مورد نحوه کار این سیستمها و اینکه آیا با هوشمندتر شدن و احتمالاً پیشی گرفتن از هوش انسانی در همه زمینهها مطابق با منافع انسانی باقی میمانند یا نه وجود دارد. هیچ نظارتی بر این فناوری وجود ندارد. درعوض ما به شرکتهایی که آنها را برای خودمختاری میسازند، تکیه میکنیم. در زمانی که انگیزههای سود و هیجان در مورد این فناوری، آنها را به سمت حرکت سریع و شکستن مرزها سوق میدهد، تنها افرادی که میتوانند به مردم هشدار دهند ما هستیم.

شرکتهای اوپنایآی، گوگل دیپمایند و آنتروپیک هنوز به درخواست خبرنگاران و رسانهها برای اظهارنظر درباره این نامه پاسخ ندادهاند. تنها سخنگوی شرکت اوپنایآی در بیانیهای که برای بلومبرگ ارسال کرده گفت که این شرکت به سوابق خود در ارائه قویترین و ایمنترین سیستمهای هوش مصنوعی افتخار میکند و به رویکرد علمی خود برای مقابله با خطر اعتقاد دارد. وی افزود: ما موافقیم که بحثهای دقیق با توجه به اهمیت این فناوری بسیار مهم است و ما به تعامل با دولتها، جامعه مدنی و سایر جوامع در سراسر جهان ادامه خواهیم داد.

امضاکنندگان این نامه از شرکتهای هوش مصنوعی خواستهاند که به چهار اصل کلیدی زیر پایبند باشند:

خودداری از انتقام گرفتن از کارکنانی که نگرانیهای ایمنی را بیان میکنند.

پشتیبانی از یک سیستم ناشناس برای افشاگران برای هشدار به مردم و نهادهای نظارتی در مورد خطرات هوش مصنوعی

اجازه دادن به فرهنگ انتقاد آشکار

پرهیز از توافقنامههای اجباری یا عدم افشا که کارمندان را از صحبت کردن درباره این موارد بازمیدارد.

این نامه در بحبوحه بررسیهای فزاینده روی شیوههای اوپنایآی از جمله انحلال تیم ایمنی خود و خروج چهرههای کلیدی مانند یکی از بنیانگذاران آن به نام ایلیا ساتسکور(Ilya Sutskever) و یان لیک(Jan Leike) که از اولویت دادن معرفی محصولات چشمپرکن و پر زرق و برق بر ایمنی انتقاد کردند، منتشر شده است.